Sintaxă:

Deoarece suntem familiarizați cu ChatGPT, știm că această platformă este deținută de comunitatea Open AI și oferă instrumente, arhitecturi, API-uri și mai multe cadre pe care le putem utiliza în implementarea aplicațiilor noastre și a modelelor de procesare a limbajului natural. Open AI oferă API-uri prin care putem folosi orice model AI și NLP pre-instruit de pe platforma Open AI și le putem face să funcționeze pentru aplicațiile noastre, cum ar fi, de exemplu, pentru a oferi predicții asupra datelor în timp real. De asemenea, GPT4All oferă utilizatorilor săi să-și integreze modelele AI pre-antrenate cu diferite aplicații.

Modelul GPT4All este antrenat pe date limitate în comparație cu ChatGPT. Are, de asemenea, unele dintre constrângerile sale de performanță în comparație cu ChatGPT, dar permite utilizatorului să-și folosească GPT-ul privat pe hardware-ul local și nu necesită conexiuni la rețea. Cu ajutorul acestui articol, vom cunoaște cum putem folosi modelele GPT4All în script-ul Python, deoarece GPT4All are legăturile oficiale cu Python, ceea ce înseamnă că putem folosi și integra modelele GPT4All și prin script-ul Python.

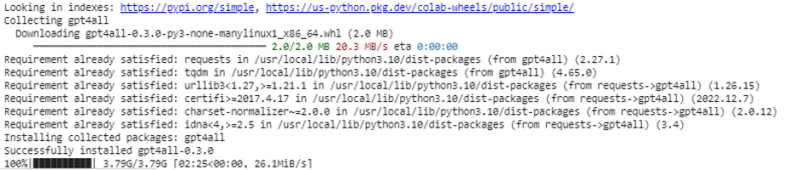

Este nevoie de o comandă online pentru a instala GPT4All pentru IDE-ul Python. Apoi, putem integra atât de multe modele AI câte aplicații noastre. Comanda pentru a instala acest GPT4All în Python este așa cum se arată în următoarele:

$ pip install gpt4all

Exemplul 1:

Pentru a începe cu acest exemplu, trebuie să descarcăm și să instalăm Python în sistemele noastre. Versiunile recomandate de Python sunt „versiunea 3.7” sau cele care au venit după această versiune. O altă modalitate de a lucra cu Python pentru a evita procesul lung de instalare a „Configurației Python” pe sistemele noastre este utilizarea „Google Colab”, care este un mediu bazat pe cloud pentru Python. Putem rula acest mediu pe orice browser web și putem construi modele de AI și de învățare automată. Exemplele pe care le vom implementa aici sunt executate în Google Colab.

Acest exemplu acoperă metoda de instalare a GPT4All în Python și modul de utilizare a modelelor sale pre-antrenate. Începem prin a instala mai întâi GPT4All. Pentru asta, comanda pe care am menționat-o anterior este executată. Odată cu executarea comenzii, GPT4All împreună cu pachetele și cadrele sale sunt descărcate și instalate.

Acum, mergem înainte. Din GPT4All, importăm „GPT4All”. Acest lucru adaugă la proiect toate modelele pre-antrenate de la GPT4All. Acum, putem folosi orice model și îl putem face să facă predicțiile pentru aplicația noastră. Odată ce importăm pachetul GPT4All, acum este timpul să apelăm această funcție și să folosim modelul GPT4All care oferă rezultatul pentru „finalizarea chatului”.

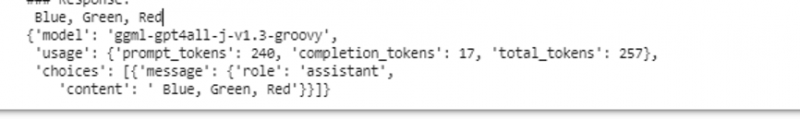

Cu alte cuvinte, dacă întrebăm ceva de la acel model în intrare, acesta îl returnează în ieșire. Modelul pe care îl folosim aici este „ggml-gpt4all-j-v1.3-groovy”. Aceste modele sunt deja stocate în memoria cache GPT4All. Putem obține aceste modele de la acest link „ https://github.com/nomic-ai/gpt4all/tree/main/gpt4all-chat ” pentru descărcare manuală. Dacă modelul este deja prezent în memoria cache GPT4All, numim pur și simplu numele modelului și îl specificăm ca parametri de intrare în funcția „GPT4All()”. Dacă l-am descărcat manual cu succes, trecem calea către folderul în care se află modelul. Deoarece acest model este pentru completarea mesajului, sintaxa pentru acest model este dată după cum urmează:

$ Chat_completion (mesaje)Mesajele sunt o listă de dicționar și fiecare dicționar ar trebui să conțină o cheie „rol” cu o valoare a utilizatorului, a sistemului sau a asistentului și conținutul „cheie” care are valoarea ca șir. În acest exemplu, specificăm conținutul ca „nume trei culori” și cheia rolului ca „utilizator”.

$model= GPT4All('ggml-gpt4all-j-v1.3-groovy')$messages = [{'role': 'utilizator', 'conținut': 'Numiți 3 flori'}]

După această specificație, numim funcția „chat_completion()” cu modelul. Codul pentru aceasta este afișat în următoarea ieșire:

$ !pip install gpt4alldin gpt4all import GPT4All

model = GPT4All('ggml-gpt4all-j-v1.3-groovy')

mesaje = [{'role': 'utilizator', 'conținut': 'Numiți trei culori'}]

model.chat_completion(mesaje)

După executarea acestui exemplu, modelul returnează trei culori ca răspuns la intrare.

Exemplul 2:

Acoperim un alt exemplu în care descoperim o altă metodă de a folosi GPT4All în Python. Acest lucru se poate face folosind legăturile oficiale pentru Python, furnizate de „Nomic”, care este o comunitate open-source AI și rulează GPT4All. Folosind următoarea comandă, integrăm „nomic” în consola noastră Python:

$ pip install nomicOdată ce acesta este instalat, importăm GPT4All din „nomic.gpt4all”. După importarea GPT4All, inițializam GPT4All cu funcția „open()”. Apoi, apelăm funcția „prompt()” și transmitem un prompt acestei funcție. Apoi, un răspuns prompt este generat pe baza promptului pe care l-am dat ca intrare modelului prompt.

!pip install nomicdin nomic.gpt4all import GPT4All

# Inițializați modelul GPT4All

initiate = GPT4All()

initiate.open()

# Generarea unui răspuns pe baza promptului

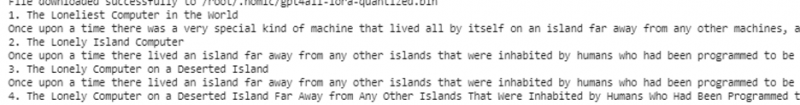

model_response = initiate.prompt('scrie o scurtă poveste despre un computer)

# afișarea răspunsului generat

print(răspuns_model)

Ieșirea afișează răspunsul prompt de la modelul pe care l-am generat folosind modelul GPT4All pre-antrenat în Python. Dacă dorim să știm mai multe despre modele și despre cum putem folosi aceste modele pentru a genera răspunsuri sau, în cuvinte simple, dacă dorim să obținem cunoștințe despre sintaxa pentru a genera răspunsurile de la aceste modele, putem primi ajutor suplimentar de la GPT4Toate detaliile documentației tehnice.

Concluzie

GPT4All încă se străduiește să obțină acuratețea performanței. Este condus de platforma nomic AI, care își propune să ofere utilizatorilor săi chatboți inteligenți artificial pe procesoarele de calitate pentru consumatori, deoarece GPT4All funcționează fără nicio conexiune la rețea și GPU-uri. Acest articol ne luminează să folosim cu competență PyGPT4All într-un mediu Python și să creăm o interacțiune între aplicațiile noastre și modelele GPT4All AI pre-antrenate. Am acoperit două metode diferite despre cum să instalați GPT4All în Python în acest ghid.