LangChain este cadrul care poate fi folosit pentru a importa biblioteci și dependențe pentru construirea de modele de limbaj mari sau LLM-uri. Modelele de limbaj folosesc memoria pentru a stoca date sau istoric în baza de date ca observație pentru a obține contextul conversației. Memoria este configurată pentru a stoca cele mai recente mesaje, astfel încât modelul să poată înțelege solicitările ambigue date de utilizator.

Acest blog explică procesul de utilizare a memoriei în LLMChain prin LangChain.

Cum se utilizează memoria în LLMChain prin LangChain?

Pentru a adăuga memorie și a o utiliza în LLMChain prin LangChain, biblioteca ConversationBufferMemory poate fi utilizată importând-o din LangChain.

Pentru a învăța procesul de utilizare a memoriei în LLMChain prin LangChain, parcurgeți următorul ghid:

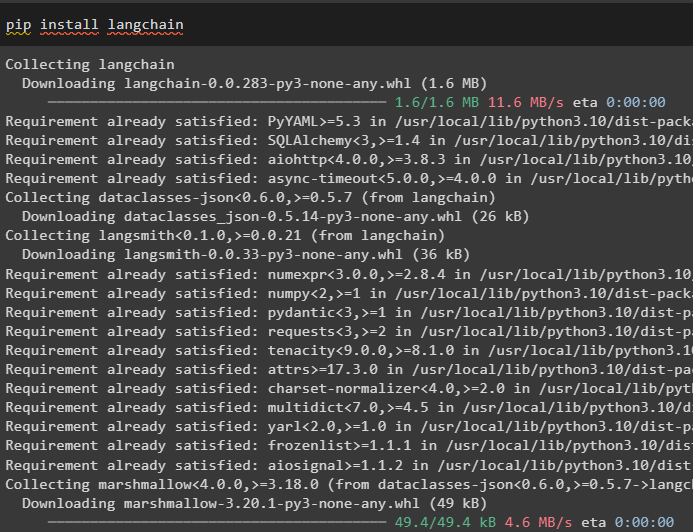

Pasul 1: Instalați module

Mai întâi, începeți procesul de utilizare a memoriei instalând LangChain folosind comanda pip:

pip install langchain

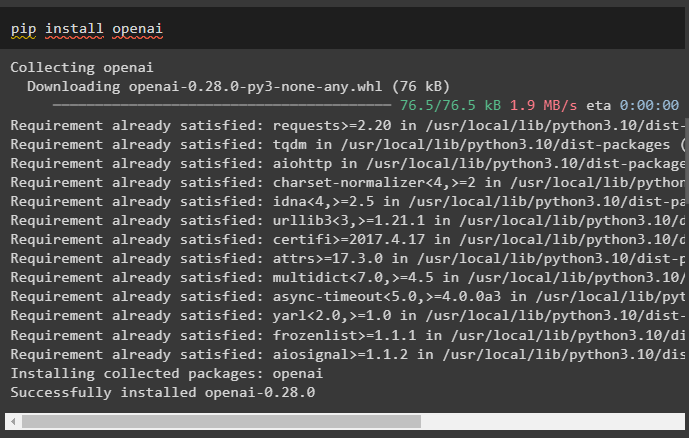

Instalați modulele OpenAI pentru a obține dependențele sau bibliotecile sale pentru a construi LLM-uri sau modele de chat:

pip install openai

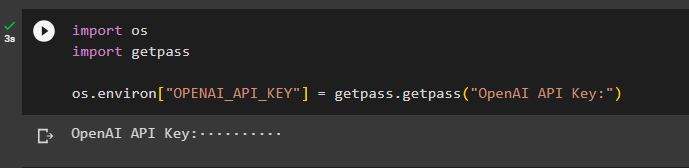

Configurați mediul pentru OpenAI folosind cheia API prin importul bibliotecilor OS și getpass:

importă-neimport getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

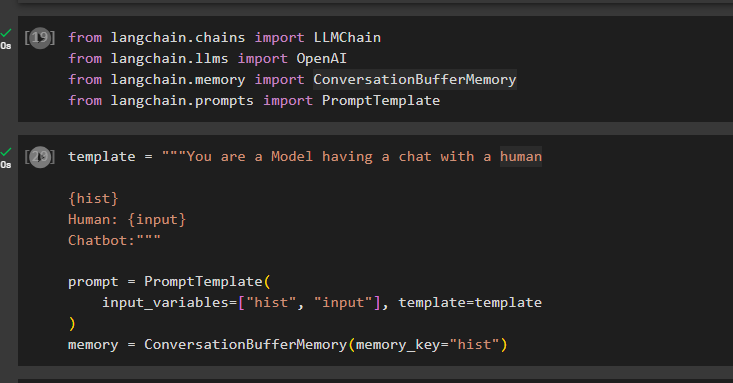

Pasul 2: Importul bibliotecilor

După configurarea mediului, pur și simplu importați bibliotecile precum ConversationBufferMemory din LangChain:

din langchain.chains import LLMChaindin langchain.llms import OpenAI

din langchain.memory import ConversationBufferMemory

din langchain.prompts import PromptTemplate

Configurați șablonul pentru prompt folosind variabile precum „input” pentru a obține interogarea de la utilizator și „hist” pentru stocarea datelor în memoria tampon:

template = '''Ești un model care discută cu un om{hist}

Om: {input}

Chatbot:'''

prompt = PromptTemplate(

input_variables=['hist', 'input'], șablon=șablon

)

memorie = ConversationBufferMemory(memory_key='hist')

Pasul 3: Configurarea LLM

Odată ce șablonul pentru interogare este construit, configurați metoda LLMChain() folosind mai mulți parametri:

llm = OpenAI()llm_chain = LLMChain(

llm=llm,

prompt=prompt,

verbose=Adevărat,

memorie = memorie,

)

Pasul 4: Testarea LLMChain

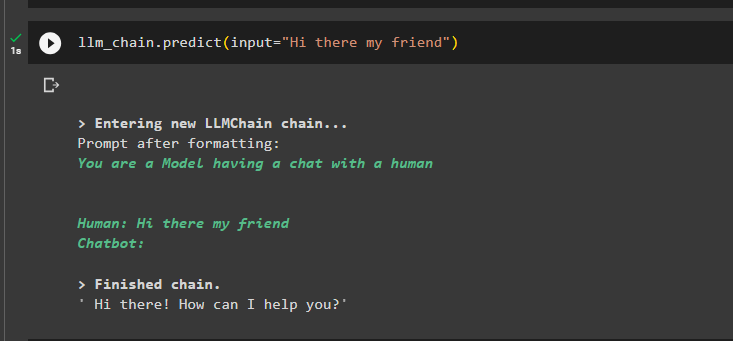

După aceea, testați LLMChain folosind variabila de intrare pentru a obține solicitarea de la utilizator în formă textuală:

llm_chain.predict(input='Salut, prietene')

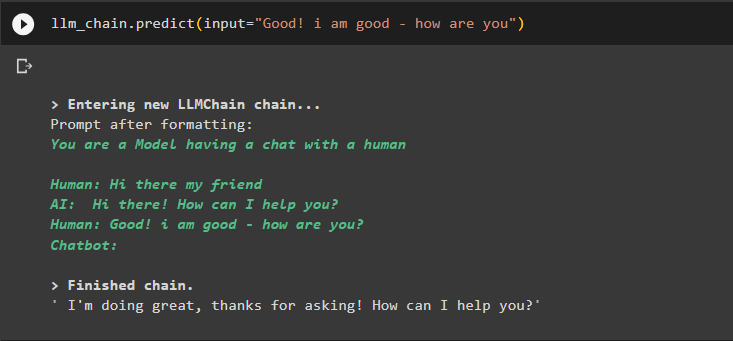

Utilizați o altă intrare pentru a obține datele stocate în memorie pentru extragerea ieșirii folosind contextul:

llm_chain.predict(input='Bine! Sunt bine - ce mai faci')

Pasul 5: Adăugarea memoriei la un model de chat

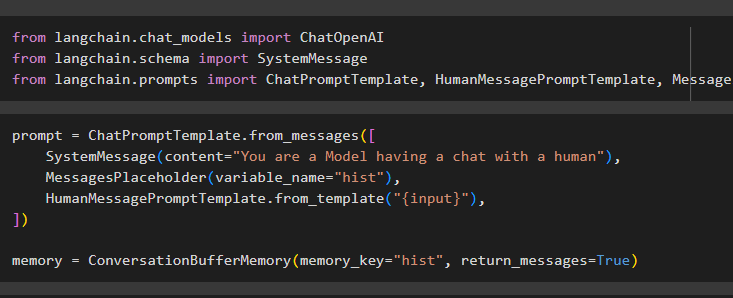

Memoria poate fi adăugată la LLMChain bazat pe modelul de chat prin importul bibliotecilor:

din langchain.chat_models import ChatOpenAIdin langchain.schema import SystemMessage

din langchain.prompts import ChatPromptTemplate, HumanMessagePromptTemplate, MessagesPlaceholder

Configurați șablonul prompt folosind ConversationBufferMemory() folosind diferite variabile pentru a seta intrarea de la utilizator:

prompt = ChatPromptTemplate.from_messages([SystemMessage(content='Sunteți un model care discutați cu un om'),

MessagesPlaceholder(variable_),

HumanMessagePromptTemplate.from_template('{input}'),

])

memorie = ConversationBufferMemory(memory_key='hist', return_messages=True)

Pasul 6: Configurarea LLMChain

Configurați metoda LLMChain() pentru a configura modelul folosind diferiți argumente și parametri:

llm = ChatOpenAI()chat_llm_chain = LLMChain(

llm=llm,

prompt=prompt,

verbose=Adevărat,

memorie = memorie,

)

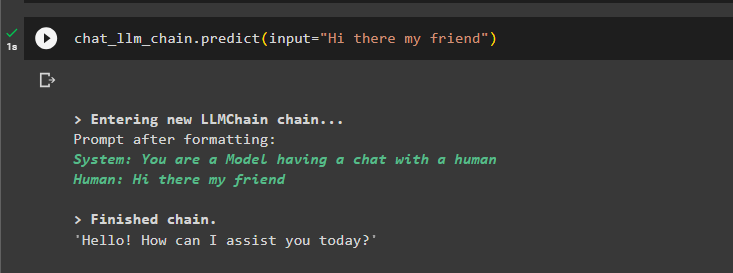

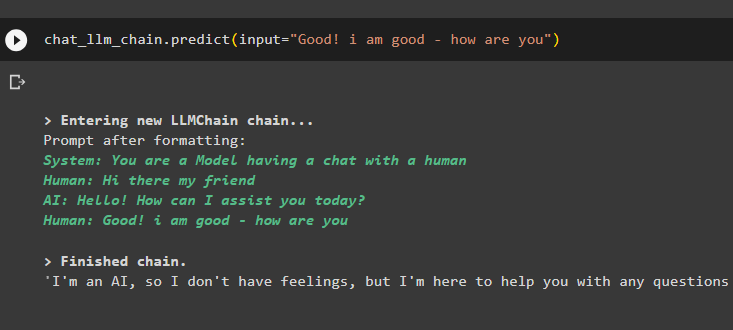

Pasul 7: Testarea LLMChain

La sfârșit, pur și simplu testați LLMChain folosind intrarea, astfel încât modelul să poată genera textul conform promptului:

chat_llm_chain.predict(input='Salut, prietene')

Modelul a stocat conversația anterioară în memorie și o afișează înainte de ieșirea efectivă a interogării:

llm_chain.predict(input='Bine! Sunt bine - ce mai faci')

Acesta este totul despre utilizarea memoriei în LLMChain folosind LangChain.

Concluzie

Pentru a utiliza memoria în LLMChain prin cadrul LangChain, pur și simplu instalați modulele pentru a configura mediul pentru a obține dependențele de la module. După aceea, pur și simplu importați bibliotecile din LangChain pentru a utiliza memoria tampon pentru stocarea conversației anterioare. De asemenea, utilizatorul poate adăuga memorie la modelul de chat prin construirea LLMChain și apoi testând lanțul prin furnizarea de intrare. Acest ghid a elaborat procesul de utilizare a memoriei în LLMChain prin LangChain.