Acest ghid va ilustra procesul de încărcare a lanțurilor de la LangChain Hub.

Cum să adăugați starea memoriei în lanț folosind LangChain?

Starea memoriei poate fi utilizată pentru a inițializa lanțurile, deoarece se poate referi la valoarea recentă stocată în lanțuri care va fi folosită în timp ce returnează rezultatul. Pentru a afla procesul de adăugare a unei stări de memorie în lanțuri folosind cadrul LangChain, parcurgeți pur și simplu acest ghid ușor:

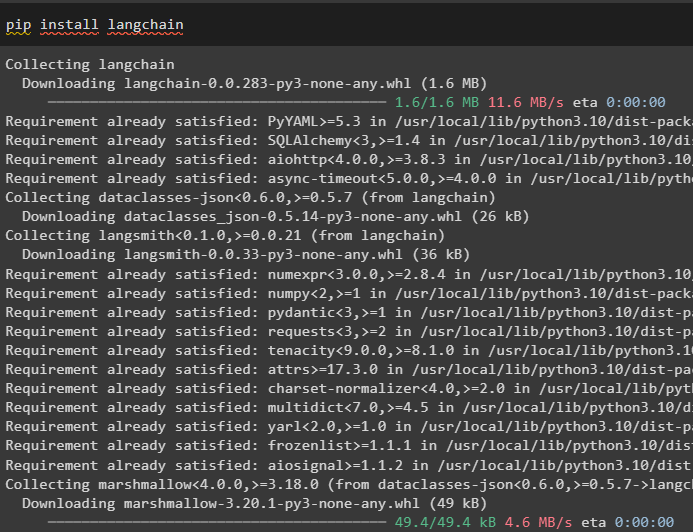

Pasul 1: Instalați module

În primul rând, intrați în proces instalând cadrul LangChain cu dependențele sale folosind comanda pip:

pip install langchain

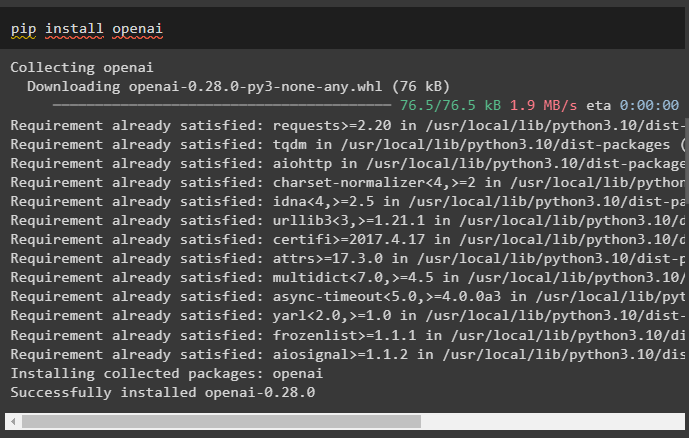

Instalați și modulul OpenAI pentru a obține bibliotecile sale care pot fi folosite pentru a adăuga starea memoriei în lanț:

pip install openai

Obțineți cheia API din contul OpenAI și configura mediul folosind-o astfel încât lanțurile să poată accesa el:

import tu

import getpass

tu . aproximativ [ „OPENAI_API_KEY” ] = getpass . getpass ( „Cheia API OpenAI:” )

Acest pas este important pentru ca codul să funcționeze corect.

Pasul 2: importați biblioteci

După configurarea mediului, pur și simplu importați bibliotecile pentru a adăuga starea memoriei, cum ar fi LLMChain, ConversationBufferMemory și multe altele:

din langchain. lanţuri import ConversationChaindin langchain. memorie import ConversationBufferMemory

din langchain. chat_models import ChatOpenAI

din langchain. lanţuri . llm import LLMChain

din langchain. solicitări import PromptTemplate

Pasul 3: Construirea lanțurilor

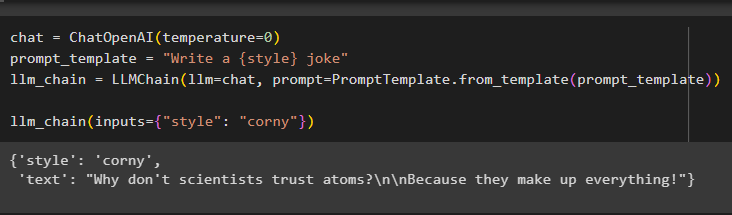

Acum, pur și simplu construiți lanțuri pentru LLM folosind metoda OpenAI() și șablonul promptului folosind interogarea pentru a apela lanțul:

conversație = ChatOpenAI ( temperatura = 0 )prompt_template = „Scrieți o glumă {style}”

llm_chain = LLMChain ( llm = conversație , prompt = PromptTemplate. din_şablon ( prompt_template ) )

llm_chain ( intrări = { 'stil' : 'scurtat' } )

Modelul a afișat rezultatul folosind modelul LLM așa cum este afișat în captura de ecran de mai jos:

Pasul 4: Adăugarea stării memoriei

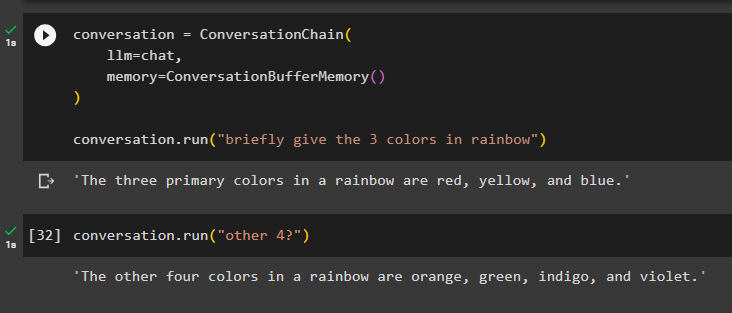

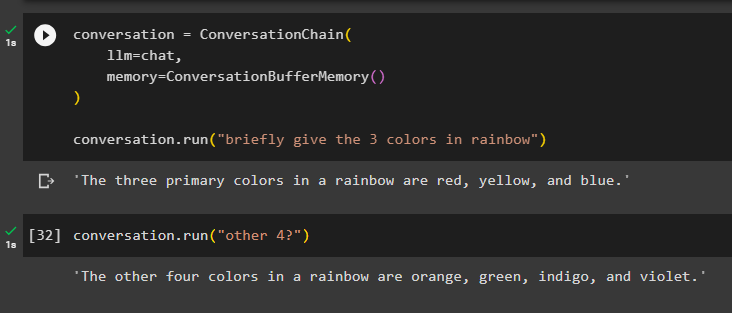

Aici vom adăuga starea memoriei în lanț folosind metoda ConversationBufferMemory() și vom rula lanțul pentru a obține 3 culori din curcubeu:

conversaţie = ConversationChain (llm = conversație ,

memorie = ConversationBufferMemory ( )

)

conversaţie. alerga ( „dați pe scurt cele 3 culori în curcubeu” )

Modelul a afișat doar trei culori ale curcubeului și contextul este stocat în memoria lanțului:

Aici rulăm lanțul cu o comandă ambiguă ca „ alte 4? ” astfel încât modelul în sine obține contextul din memorie și afișează culorile curcubeului rămase:

conversaţie. alerga ( 'alte 4?' )Modelul a făcut exact asta, deoarece a înțeles contextul și a returnat cele patru culori rămase din setul curcubeu:

Este vorba despre încărcarea lanțurilor de la LangChain Hub.

Concluzie

Pentru a adăuga memoria în lanțuri folosind cadrul LangChain, pur și simplu instalați module pentru a configura mediul pentru construirea LLM. După aceea, importați bibliotecile necesare pentru a construi lanțurile în LLM și apoi adăugați starea memoriei la acesta. După ce adăugați starea memoriei în lanț, pur și simplu dați o comandă lanțului pentru a obține rezultatul și apoi dați o altă comandă în contextul celei anterioare pentru a obține răspunsul corect. Această postare a elaborat procesul de adăugare a unei stări de memorie în lanțuri folosind cadrul LangChain.