LangChain este cadrul cu aplicația în domeniul procesării limbajului natural sau NLP pentru a construi modele în limbaje asemănătoare oamenilor. Aceste modele pot fi folosite de oameni pentru a obține răspunsuri de la model sau pentru a avea o conversație ca orice alt om. LangChain este folosit pentru a construi lanțuri prin stocarea fiecărei propoziții din conversație și interacționând în continuare folosind-o ca context.

Această postare va ilustra procesul de construire a LLM și LLMChain în LangChain.

Cum să construiți LLM și LLMChain în LangChain?

Pentru a construi LLM și LLMChain în LangChain, parcurgeți pașii enumerați:

Pasul 1: Instalați module

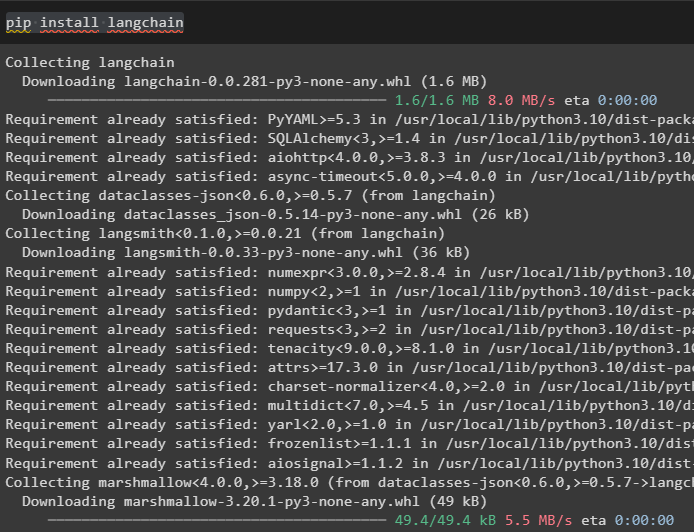

În primul rând, instalați modulul LangChain pentru a-și folosi bibliotecile pentru a construi LLM-uri și LLMChain:

pip install langchain

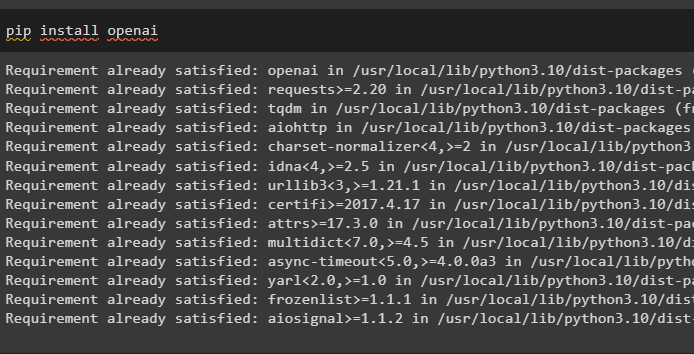

Un alt modul care este necesar pentru a construi LLM-uri este OpenAI și poate fi instalat folosind comanda pip:

pip install openai

Pasul 2: Configurați un mediu

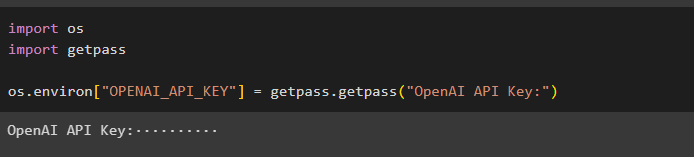

Configurați un mediu folosind cheia API OpenAI din mediul său:

importă-neimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

Exemplul 1: Construiți LLM-uri folosind LangChain

Primul exemplu este de a construi modele de limbaj mari folosind LangChain, importând bibliotecile OpenAI și ChatOpenAI și folosiți funcția llm():

Pasul 1: Utilizarea modelului de chat LLM

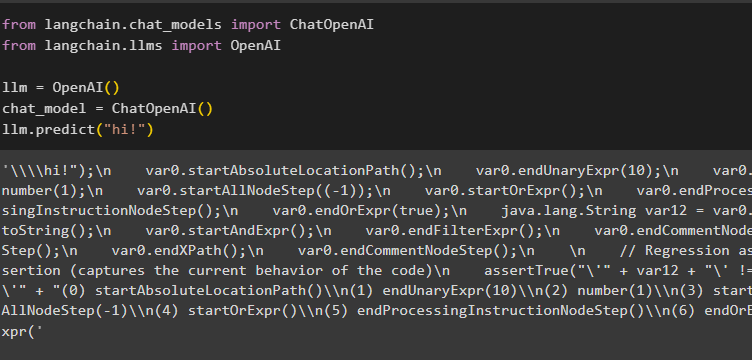

Importați module OpenAI și ChatOpenAI pentru a construi un LLM simplu folosind mediul OpenAI de la LangChain:

din langchain.chat_models import ChatOpenAIdin langchain.llms import OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict(„bună!”)

Modelul a răspuns cu răspunsul „bună”, așa cum este afișat în următoarea captură de ecran de mai jos:

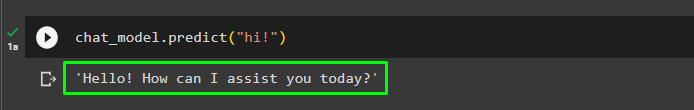

Funcția predict() din chat_model este folosită pentru a obține răspunsul sau răspunsul de la model:

chat_model.predict(„bună!”)Ieșirea arată că modelul este la dispoziția utilizatorului care solicită întrebări:

Pasul 2: Utilizarea interogării text

De asemenea, utilizatorul poate obține răspunsuri de la model dând propoziția completă în variabila text:

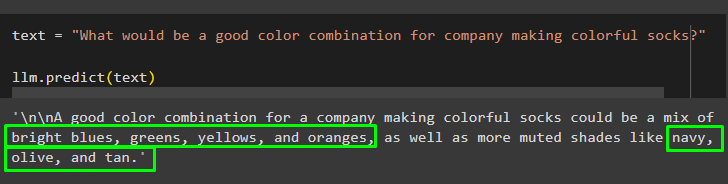

text = 'Care ar fi un nume bun de companie pentru o companie care face șosete colorate?'llm.predict(text)

Modelul a afișat mai multe combinații de culori pentru șosete colorate:

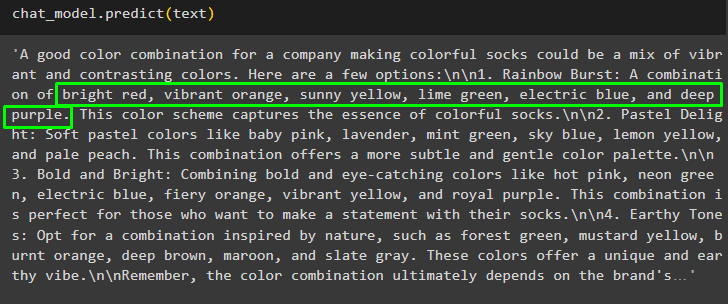

Obțineți răspunsul detaliat de la model folosind funcția predict() cu combinațiile de culori pentru șosete:

chat_model.predict(text)

Pasul 3: Utilizarea textului cu conținut

Utilizatorul poate obține răspunsul cu o mică explicație despre răspuns:

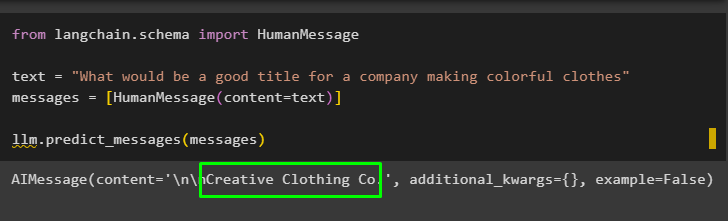

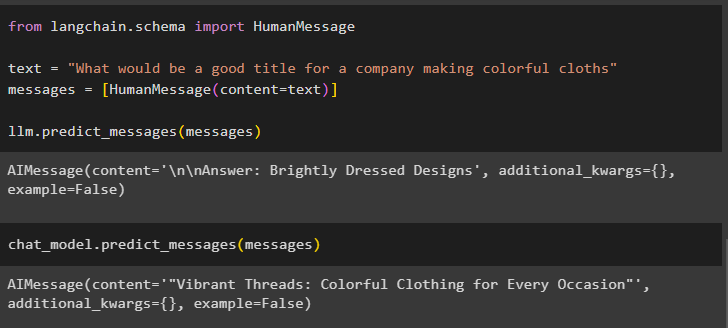

din langchain.schema import HumanMessagetext = „Care ar fi un titlu bun pentru o companie care produce haine colorate”

mesaje = [HumanMessage(conținut=text)]

llm.predict_messages(mesaje)

Modelul a generat titlul companiei care este „Creative Clothing Co”:

Preziceți mesajul pentru a obține răspunsul și pentru titlul companiei cu explicația sa:

chat_model.predict_messages(mesaje)

Exemplul 2: Construiți LLMChain folosind LangChain

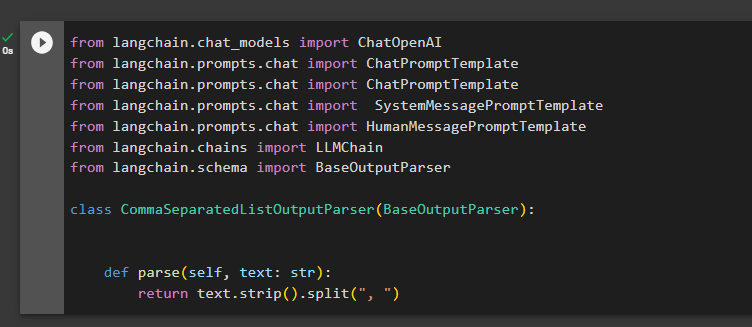

Al doilea exemplu al ghidului nostru construiește LLMChain pentru a obține modelul în formatul interacțiunii umane pentru a combina toți pașii din exemplul anterior:

din langchain.chat_models import ChatOpenAIdin langchain.prompts.chat import ChatPromptTemplate

din langchain.prompts.chat import ChatPromptTemplate

din langchain.prompts.chat import SystemMessagePromptTemplatefrom langchain.prompts.chat import HumanMessagePromptTemplate

din langchain.chains import LLMChain

din langchain.schema import BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

returnează text.strip().split(', ')

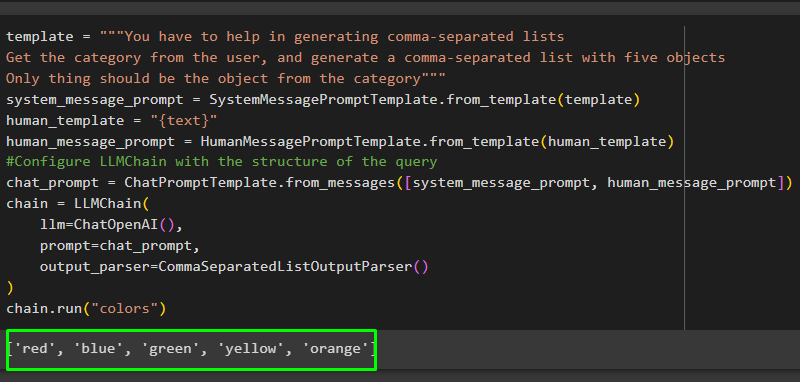

Construiți șablonul pentru modelul de chat oferind o explicație detaliată a funcționării acestuia și apoi construiți funcția LLMChain() care conține bibliotecile LLM, parser de ieșire și chat_prompt:

template = '''Trebuie să ajuți la generarea listelor separate prin virgulăObțineți categoria de la utilizator și generați o listă separată prin virgulă cu cinci obiecte

Singurul lucru ar trebui să fie obiectul din categoria '''

system_message_prompt = SystemMessagePromptTemplate.from_template(șablon)

human_template = '{text}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Configurați LLMChain cu structura interogării

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

lanț = LLMChain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run ('culori')

Modelul a oferit răspunsul cu lista de culori, deoarece categoria ar trebui să conțină doar 5 obiecte date în prompt:

Acesta este totul despre construirea LLM și LLMChain în LangChain.

Concluzie

Pentru a construi LLM și LLMChain folosind LangChain, instalați pur și simplu modulele LangChain și OpenAI pentru a configura un mediu folosind cheia API. După aceea, construiți modelul LLM folosind chat_model după ce ați creat șablonul de prompt pentru o singură interogare la un chat complet. LLMChain sunt folosite pentru a construi lanțuri de toate observațiile din conversație și pentru a le folosi ca context al interacțiunii. Această postare ilustrează procesul de construire a LLM și LLMChain folosind cadrul LangChain.